True peak metering: qué es y cómo usarlo

- Un poco de historia

- La importancia del pico

- El pico en digital: true peak y el ‘non-true peak’

- ¿Ha perdido la versión muestreada el verdadero pico?

- El problema: normalizar sin pensar en el pico verdadero

- El consejo tradicional: no normalices al 100%

- La solución actual: normaliza al ‘true peak’

- El estándar para obtención del ‘true peak’ en ITU BS.1770

- Cómo de bueno es el ‘true peak’ de ITU BS.1770

- El TP mejorado

- Normalización TP, cómo ajustarla en la práctica

La nueva métrica ‘true peak’ lleva a pensar que la 'peak' a secas que ha sido común durante mucho tiempo medía un falso pico. Y así es. Para no seguir en el engaño es necesario entender origen y beneficios del ‘true peak’.

Hubo un día en que vúmetros RMS y picómetros era todo lo que teníamos para observar el detalle del nivel de nuestras señales audio y no parecía que viviéramos mal. Pero las técnicas de registro sonoro en el fondo son relativamente recientes, y mucho más aún su madurez. Y es con su madurez cuando llega la preocupación por el aseguramiento de la calidad y el interés por sistemas y estándares de medición. Las nuevas técnicas y las nuevas calidades en la grabación y reproducción sonora conllevan nuevas métricas, como la que hoy nos ocupa.

Podríamos remontarnos al fonoautógrafo de Édouard-Léon Scott de Martinville, patentado en 1857 y capaz de registrar una representación de un sonido pero sin posibilidad de reproducirlo, o al fonógrafo de Edison de 1877 que es típicamente considerado como el primer grabador/reproductor de sonido. Pero pensar en esas primeras grabaciones sobre cilindros y discos de cera o pizarra es pensar en un sonido válido como testimonio pero, para los estándares elevados de hoy, carente de una calidad que permita una escucha realmente placentera.

Durante muchísimas décadas en esa historia del registro sonoro, antes del asentamiento de la digitalización como forma de grabación, el vúmetro y el picómetro han sido los compañeros con los que hemos convivido para ojear cómo andaban de nivel nuestras señales. El vúmetro ofreciendo una referencia de tipo promedio, típicamente mediante una estrategia RMS (root mean square) que informa del nivel a medio plazo. El picómetro dándonos información mucho más ágil relativa al comportamiento ‘instantáneo’ de la señal y capaz por tanto de alertarnos de la presencia de potencialmente peligrosos picos breves que en una medición RMS sencillamente desaparecen bajo el efecto de la inercia y el promediado propios de medidas ‘a medio plazo’.

El objetivo del picómetro siempre ha sido ofrecernos una referencia fiable para evitar que los picos de nuestra señal sobrepasen el margen de funcionamiento ‘correcto’ del sistema. Cuando vemos el indicador ‘peak’ activo sabemos que hay que reducir nivel si no queremos introducir una distorsión severa de los picos.

En sistemas analógicos es lo habitual que exista una ‘saturación’ natural que en cierta forma ‘achata’ los picos y puede hacer más tolerable la entrada (sólo ocasional) en el territorio ‘rojo’ del picómetro. Sin embargo, en digital, superar el nivel 0dBFS que corresponde al ‘fondo de escala’ (‘Full Scale’) implica la aparición del temido recorte o ‘clipping’. Nada de un achatamiento de los picos sino su corte recto a tijera que es demasiado evidente al oído en forma de un chasquido llamativo y molesto.

No es de extrañar por tanto que aunque fuera sólo una referencia de importancia secundaria en analógico, el picómetro se vuelve capital en los entornos digitales.

Importante como es la cuestión del pico en digital, se hace llamativo que sólo recientemente haya pasado a existir interés general por caracterizar el ‘true peak’ (pico verdadero). Su denominación hace referencia a que hemos estado usando algo que no era el pico real.

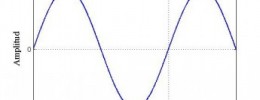

La digitalización del audio en un convertidor A/D implica el uso de una representación en la que conservamos sólo los valores instantáneos en determinados momentos, los instantes de muestreo. No se registra la evolución de la señal durante el tiempo que media entre dos muestras. Y bien puede pasar que el verdadero pico caiga a mitad entre dos muestras. En la imagen tenéis representada una señal senoidal de 3200Hz muestreada a 44100Hz pudiendo apreciarse que considerar sólo los valores instantáneos de las muestras no garantiza que estemos observando los picos reales.

La senoide anterior, al ser una forma de onda repetitiva, al menos deja ver su pico verdadero de vez en cuando, aunque no en todos los ciclos, dentro del conjunto de muestras. Pero con las señales audio/musicales complejas los picos acostumbran a ser ocasionales, no repetitivos, y es más fácil que se nos escape la captura del verdadero máximo, sencillamente porque no va a volver a suceder salvo muy esporádicamente.

En una interpretación simplista del muestreo, todavía algunos aprovechan para usar esto como otra escusa más para atrincherarse en una pretendida superioridad de lo analógico: ‘Ya te lo decía yo. Nada como lo analógico. En digital pierdes detalles ricos y esenciales de la señal’.

Pero no es cierto. La representación digital no necesita tener registrado el ’true peak’ para saber de él. No lo necesita, porque puede reconstruirse la señal, incluidos sus picos, y así lo hace la vuelta a una señal continua a través de un D/A. De hecho, la línea azul en las figuras anteriores representa tanto la señal de ‘entrada’ al A/D como la que ofrecería a su salida el D/A y es capaz de manifestar la realidad: la existencia de un pico que excede del valor de la muestra más alta / más baja.

¿Cuál es el problema entonces? El que aparece al normalizar ‘a las bravas’.

El ansia por aprovechar todo el margen disponible y lograr un máximo de nivel en el audio, hace que en sistemas digitales aparezca la opción de ‘normalizar’. Hacer que el pico presente en la grabación se ajuste al ‘fondo de escala’ consigue que ganemos un poco más de nivel y margen en el producto final. Dado que muchas veces mezclamos a 24 (o más) bits y los formatos finales van a ser a 16 (o menos) la normalización nos permite aprovechar al máximo los 96dB de margen teórico que nos dan los 16 bits.

Pero si la normalización se hace con pensamiento informático ‘orientado al bit’ y no con pensamiento audio ‘orientado a la señal’ caemos en un error. Elevar la señal para que la muestra más alta coincida con el ‘Full Scale’ de la representación digital hace que en el convertidor D/A la señal analógica resultante exija niveles más allá. Fijaos como en esta nueva figura (la misma señal anterior pero con normalización a 0dBFS) la señal reconstruida (azul) entra en la zona roja: excede del nivel máximo que pretendidamente queríamos garantizar.

Niveles que en muchos casos pueden resultar ‘fuera de límites’ para el propio convertidor o para los elementos que van a continuación de él y que están concebidos y ajustados pensando que el nivel ‘Full Scale’ jamás va a a sobrepasarse.

En el fondo, esta argumentación no hace sino reforzar el sentido de una recomendación práctica que siempre ha existido: cuando uses la normalización en una grabación digital no la fuerces al 100%. Cualquier editor de audio permite normalizar, pero asumimos riesgos innecesarios cuando le pedimos que ajuste el pico al valor ‘full scale’ completo dejando el nuevo pico en 0dBFS, de forma que la muestra más alta este en el extremo de su recorrido.

La recomendación siempre ha sido quedarse un poco por debajo al normalizar, aunque sea sólo un dB. Y entendemos ahora uno de los porqués. Cuando un soft de normalización te ofrece ajustar el nuevo valor de pico a 0dBFS, tentador como resulta, hay que saber que es mejor dejar un poco de hueco.

Ante ese problema de que muchos usuarios de lo digital se han acostumbrado a normalizar ‘al límite’ tal como hacen por defecto muchas herramientas (con los consiguientes posibles problemas) o bien a curarse en salud con algún dB que otro de tranquilidad (y por tanto dejando escapar una pequeña mejora posible), surge la invención de la medida ‘true peak’ que ha acabado definida en forma de estándares. Quiere resolver ese dilema aportando una medida confiable del verdadero pico que pueda usarse como nueva referencia para normalizar a 0dBTP en lugar de a 0dBFS.

Si vigilamos que nuestro contenido no exceda el verdadero pico, ajustando cualquier normalización respecto al ‘true peak’, podemos tener la tranquilidad de aprovechar el máximo del espacio disponible en la profundidad de bits elegida pero a la vez no incurrir en sobrepasar niveles en la reconstrucción de la señal continua.

¿Qué hace falta para poder conocer el ‘true peak’? Se puede reconstruir digitalmente cuál sería la evolución de la señal en los periodos intermuestras mediante sobremuestreo, para tener opción de valorar el verdadero pico y por tanto poder usarlo para cualquier ajuste de normalización necesario.

Detectar perfectamente el pico verdadero obligaría a una reconstrucción (interpolación) muy detallada de la evolución de la señal que es exigente en cómputo. Por eso los estándares que se han definido para el ‘true peak’ buscan una solución de compromiso. Suficientemente cercana al ‘true peak’ pero desde unas necesidades de cómputo más reducidas.

Con el título de ‘Algoritmos para medir la sonoridad de los programas radiofónicos y el nivel de cresta de audio real‘, la norma ITU BS.1770, cuyo origen se remonta a 2006 y que alcanzó en octubre de 2015 su actual versión 4, define varias mediciones para valorar la sonoridad y el pico verdadero.

Centrándonos en la cuestión ‘true peak’, para una señal originalmente muestreada a x1 (las clásicas 44,1 y 48 kHz.) la norma propone usar sobremuestreo x4 para poder así obtener una referencia mucho más adecuada del pico verdadero. Son 4 muestras en el mismo espacio de tiempo para el que antes teníamos sólo una, equivalentes a un muestreo a 192kHz. No se trata de muestrear toda la señal a 192, sino de, partiendo de la señal a 48 saber calcular 'en caliente' el valor de esas muestras intermedias más densas que puedan reflejar de forma más exacta el pico real.

Para evitar que los cálculos intermedios de ese sobremuestreo tengan problemas (nos interesa la señal en las proximidades del límite de su recorrido), especifica también reducir previamente el nivel en 12,04dB (el equivalente a dos bits) antes del sobremuestreo para finalmente compensar esa defensa. Todo eso ya está implementado en un medidor TP. aunque para curiosos aquí os dejo el diagrama de bloques del medidor de True Peak que aparece en el estándar.

La norma no impide hacer implementaciones más fieles al verdadero pico, pero establece este sobremuestreo como un mínimo, un punto de partida que muchos han implementado tal cual.

No vamos a entrar en muchos más detalles sobre la norma, que puede consultarse (es de acceso gratuito), pero sí en el hecho de que el uso del sobremuestreo x4 y con diseños prácticos de filtrado interpolador (con una computación no abusiva) deja espacio para que sobreviva algún pequeño error en la estimación. Pero las matemáticas ayudan a valorarlo con precisión y por tanto a poder defenderse contra él.

La propia norma describe que con estimación del ‘true peak’ mediante sobremuestreo x4 a partir de una señal muestreada en x1, en el caso de que la máxima frecuencia presente en la señal sea de 0.45 veces la frecuencia de muestreo el error puede llegar a ser como máximo de algo menos de 0,56 dB (muy poco), que serían 0,14dB (casi ridículo) en caso de usar x8, o 0,06 en caso de x12 (prácticamente inexistente).

Por eso algunos desarrolladores usan en su medidor TP implementaciones mejores que ese ‘mínimo de referencia’ que cita BS.1770. Por ejemplo, alguien que directamente aplique un factor x8 para la estimación del TP nos permite saber que el error máximo ya es sólo de 0,15dB.

Podremos optar por normalizar con ese ya muy ridículo margen de garantía o incluso normalizar a 0dBTP (que el pico estimado se lleve exactamente al nivel ‘fondo de escala’) sabedores de que en los pocos momentos en los que la señal reconstruida final pueda tal vez superar el máximo previsto nunca lo hará más allá de esos 0,15dB y que sólo sucederá en picos muy ocasionales en la señal.

Estad atentos por tanto a la información de vuestras aplicaciones en relación a cómo obtienen su estimación del TP.

Si os ofrecen normalización al TP (es decir, forzando al normalizar la señal un nivel 0dBTP respecto al TP que se haya estimado dentro de la señal) pero no hay información/garantía sobre qué técnica de estimación aplican o sólo dicen ‘acorde a BS.1770’ sin más detalle, daros esos 0,6 dB de tranquilidad que os citaba, por si acaso. Insisto en el ‘por si acaso’: sencillamente no sabemos si va a hacer falta o no, dependerá de la señal y de la calidad del algoritmo de ‘TP’, pero poco es ese medio dB a cambio de respirar tranquilos.

Pero veréis, especialmente en soft para ‘mastering’ (es el caso por ejemplo de los medidores TP en soft de Izotope) que a veces se usa una estimación más detallada del TP y podéis acortar ese margen de tranquilidad o incluso prescindir de él totalmente.

Pero siendo sensatos, la recomendación de la norma EBU R128 respecto al true peak nos marca que en caso de normalizar la señal deberíamos hacer que su true peak quede 1dB por debajo del fondo de escala. Poca cosa es realmente 1dB y a cambio mucho hay que ganar en cuanto a tranquilidad teniendo en cuenta que los distintos sistemas no siempre son todo lo precisos que a veces suponemos.

Ya sabéis aquello de ‘el conocimiento os hará libres’. Este conocimiento de hoy os hará libres del problema del recorte inadvertido de la señal que a veces podemos provocar con una normalización poco cuidadosa. La otra, la libertad personal plena no sólo de pensamiento sino de acción, me temo que no es tan sencilla de ganar.